Cybertruck-Crash: Klägerin macht Elon Musk persönlich verantwortlich

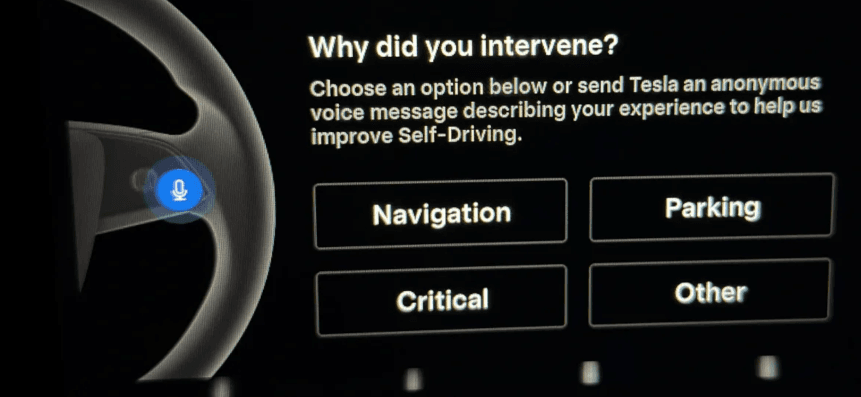

Tesla sieht sich einer neuen, juristisch brisanten Herausforderung gegenüber. Eine Frau aus Texas fordert nach einem schweren Unfall mit ihrem Cybertruck Schadensersatz in Höhe von über einer Million US-Dollar. Der Vorwurf: Das „Full Self-Driving“ (FSD) System habe im August 2025 versagt, als das Fahrzeug an einer Autobahngabelung in Houston nicht der Kurve folgte, sondern ungebremst in eine Betonwand steuerte. Die Fahrerin gibt an, trotz eines Eingreifversuchs den Aufprall nicht mehr verhindert haben zu können.

Was diese Klage von bisherigen Verfahren unterscheidet, ist die direkte Attacke auf die Führungsebene. Die Anwälte werfen Tesla „fahrlässige Einstellung und Beibehaltung von Elon Musk als CEO“ vor. Musk habe laut Klageschrift Warnungen von Ingenieuren ignoriert und entgegen fachlicher Empfehlungen auf LiDAR- oder Radarsensoren verzichtet, um stattdessen ausschließlich auf ein kamerabasiertes System („Vision-Only“) zu setzen.

Musk als „unverantwortlicher Verkäufer“

Die Anklageschrift spart nicht mit scharfer Rhetorik. Elon Musk wird darin als „aggressiver und unverantwortlicher Verkäufer“ beschrieben, der eine lange Geschichte gefährlicher Designentscheidungen und überzogener Produktversprechen hinter sich habe. Die Klägerin argumentiert, dass Musks persönliche Philosophie, Hardware-Kosten durch den Verzicht auf Sensoren zu sparen, direkt zur mangelhaften Leistung der Software beigetragen habe.

| Streitpunkt | Position der Klägerseite | Aktueller Stand / Fakten |

|---|---|---|

| Branding | „Full Self-Driving“ ist irreführend | Tesla nutzt nun oft den Zusatz „Supervised“ |

| Technik | Verzicht auf LiDAR ist fahrlässig | Tesla setzt konsequent auf Vision-Only |

| Haftung | CEO Musk ist ein Sicherheitsrisiko | Persönliche Haftung von CEOs ist schwer zu beweisen |

| Regulierung | Software ist unausgereift | NHTSA untersucht derzeit 2,88 Mio. Fahrzeuge |

Gegenwind von Behörden und Gerichten

Die Klage trifft Tesla in einer Phase, in der der regulatorische Druck massiv zunimmt. Erst Ende 2025 urteilte ein kalifornischer Richter, dass das FSD-Marketing „eindeutig falsch und kontrafaktisch“ sei. Zudem untersucht die US-Verkehrssicherheitsbehörde NHTSA derzeit fast drei Millionen Tesla-Fahrzeuge, nachdem Dutzende Unfälle mit FSD-Beteiligung gemeldet wurden. Tesla hat bereits begonnen, die Namen „Autopilot“ und „Full Self-Driving“ in Marketingmaterialien defensiver zu verwenden, um drohenden Verkaufsverboten zuvorzukommen.

Obwohl der Cybertruck selbst beim klassischen Insassenschutz Bestnoten erhält, steht nun die Software-Sicherheit am Pranger. Tesla verteidigt sich in ähnlichen Fällen meist mit dem Hinweis, dass FSD ein Level-2-System ist, das trotz seines Namens permanente menschliche Überwachung erfordert. Die Kläger hingegen argumentieren, dass das Marketing den Nutzern suggeriere, das Auto könne mehr, als es technisch leistet.

„Dieses Verfahren könnte eine Grundsatzdiskussion erzwingen: Ist die persönliche Design-Philosophie eines CEOs ein rechtliches Haftungsrisiko für den gesamten Konzern?“

Während der Fall vor dem Harris County District Court verhandelt wird, zeigt sich das Paradoxon der Tesla-KI: In vielen Videos sieht man die Software spektakuläre Ausweichmanöver bei hohen Geschwindigkeiten meistern, doch jeder einzelne Fehler wie der Crash in Houston könnte nun Millionenkosten und weitreichende Konsequenzen für das Management nach sich ziehen.