NHTSA vs. Tesla Vision: Ein technologischer Glaubenskrieg

In der Welt des autonomen Fahrens gibt es zwei Lager: Diejenigen, die auf teure Lidar- und Radarsensoren setzen (wie Waymo oder Mercedes), und Tesla. Elon Musk vertraut ausschließlich auf Kameras – das menschliche Auge als Vorbild. Doch genau dieser "Vision Only"-Ansatz steht nun erneut im Kreuzfeuer der National Highway Traffic Safety Administration (NHTSA). Die Behörde äußert die Sorge, dass das System bei schwierigen Bedingungen wie Blendung, Nebel oder Partikeln in der Luft nicht zuverlässig reagiert.

Laut NHTSA-Bericht gab es Fälle, in denen das System nicht rechtzeitig warnte, wenn die Sicht der Kameras beeinträchtigt war. Betroffen sind potenziell alle Modelle ab dem Baujahr 2016. Doch wie valide ist diese Kritik im Jahr 2026, wo die KI-Entwicklung exponentielle Sprünge macht?

Der Gegenentwurf: Warum Kameras oft unterschätzt werden

Kritiker werfen Tesla oft vor, am falschen Ende zu sparen. Doch die Tesla-Community und die Ingenieure hinter "FSD Supervised" sehen das anders. Ihr Argument: Ein Mensch fährt auch nur mit zwei "Kameras" (Augen) und einem biologischen neuronalen Netz. Tesla simuliert dies mit acht Kameras und dem leistungsstarken KI-Computer.

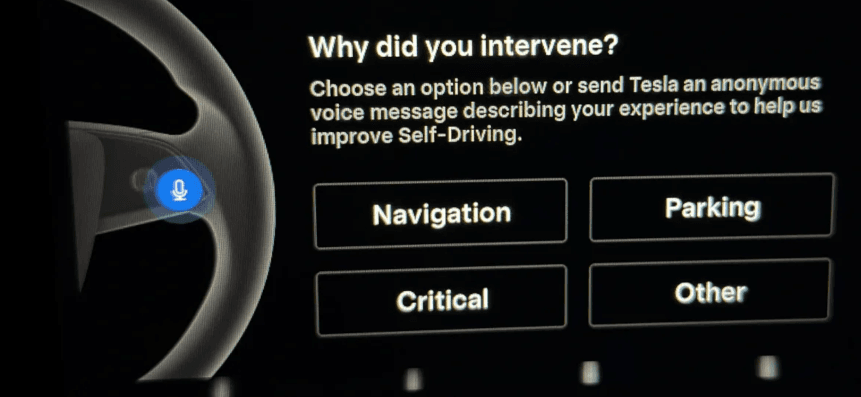

Was die NHTSA als Schwäche auslegt, könnte in Wahrheit eine Frage der Software-Iteration sein. Mit der aktuellen FSD v14.3 und dem Einsatz von End-to-End-Neural-Networks lernt das Auto nicht mehr durch starre Regeln, sondern durch Intuition. Das System "weiß" mittlerweile oft schon vor einer Warnung, wie es sich in diffusem Licht verhalten muss – ein Lerneffekt aus Milliarden gefahrenen Meilen.

| Kritikpunkt (NHTSA) | Tesla-Perspektive / Lösungsansatz |

|---|---|

| Blendung/Gegenlicht | HDR-Kameras und KI-Entblendung (Software-seitig) |

| Fehlende Sensor-Redundanz | "Redundanz durch Daten": Acht Kameras decken tote Winkel mehrfach ab. |

| Mangelnde Warnungen | Neue High-Pressure-Washer an den Kameras (z.B. beim Cybercab) verhindern Verschmutzung. |

| Reaktionszeit | Latenzfreie Verarbeitung durch den neuen AI5-Chip (ab 2027 Serie). |

Hardware vs. Software: Der wahre Engpass

Ein interessanter Aspekt der NHTSA-Untersuchung ist der Fokus auf ältere Modelle. Während Tesla bei neueren Fahrzeugen wie dem Cybercab bereits Hardware-Lösungen wie Kameralinsen-Reiniger verbaut, müssen ältere Fahrzeuge (HW3/HW4) allein auf die Optimierung der Bildverarbeitung setzen. Die Frage ist: Kann Software physikalische Grenzen der Optik komplett aushebeln? Tesla sagt ja – durch schiere Rechenpower und das Verständnis des Kontextes einer Szene.

Während Waymo in definierten Gebieten (Geofencing) mit Lidar glänzt, beweist Tesla täglich, dass Kameras auch in "unbekanntem Terrain" funktionieren. Für viele Fans ist die NHTSA-Untersuchung daher eher ein bürokratischer Rückblick auf alte Software-Stände als eine aktuelle Zustandsbeschreibung der v14-Architektur.

"Die NHTSA analysiert Unfälle der Vergangenheit. Tesla hingegen trainiert bereits die KI der Zukunft, die Blendung nicht mehr als Fehler, sondern als Teil der natürlichen Umwelt versteht und entsprechend vorsichtig agiert."

Real-World-Impact: Was bedeutet das für dich?

Lass dich von den Schlagzeilen nicht verunsichern. Jedes Mal, wenn die NHTSA eine Untersuchung einleitet, nutzt Tesla die Daten, um das nächste Software-Update noch sicherer zu machen. Für dich bedeutet das: Dein Auto wird durch "Over-the-Air"-Updates ständig besser. Dennoch gilt – wie bei jedem Level-2-System: Bleib aufmerksam, besonders wenn die Sonne tief steht oder der Regen peitscht. Die KI ist dein Co-Pilot, nicht dein Chauffeur (noch nicht!).