Das HW3-Dilemma: Wenn der Speicher zum Flaschenhals wird

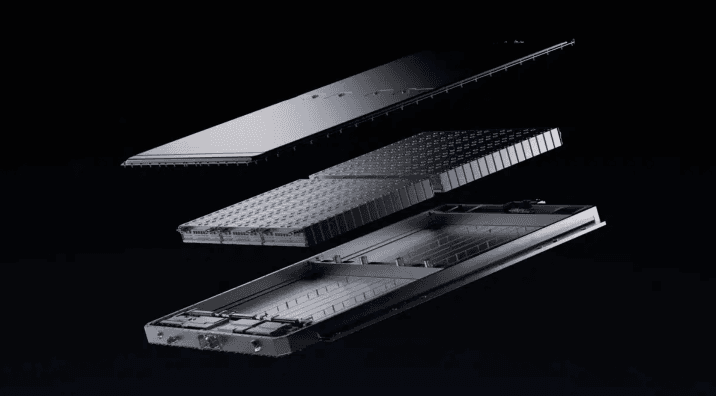

Tesla-Fahrer mit der Hardware-Generation 3 (HW3) blicken derzeit gespannt auf die Entwicklung von FSD v14. Während die neue Hardware 4 (AI4) mühelos mit den massiven neuronalen Netzen umgeht, kämpft HW3 mit einem entscheidenden Limit: dem Arbeitsspeicher (RAM). Bei der aktuellen "End-to-End"-Architektur von Tesla ist nicht nur die Rechenpower, sondern vor allem das räumlich-zeitliche Gedächtnis der KI der begrenzende Faktor.

Dieses Gedächtnis speichert Informationen über die Umgebung – etwa einen Fußgänger, der hinter einem Lieferwagen verschwunden ist. Je smarter die FSD-Version wird, desto größer wird dieser Datencache, bis der HW3-Computer schlichtweg überläuft. Bisher hieß die Lösung: "Pruning" – das Streichen von KI-Parametern, was jedoch oft zu einer "lobotomierten", also dümmeren Version der Software (v14-lite) führt.

NVIDIAs KVTC: 20-fache Kompression ohne Intelligenzverlust

Ein neuer Durchbruch von NVIDIA-Forschern im Bereich der Large Language Models (LLMs) könnte nun die Rettung sein. Die Technik nennt sich KV Cache Transform Coding (KVTC). Das Prinzip ist vergleichbar mit der JPEG-Komprimierung bei Bildern: Anstatt Daten permanent zu löschen, identifiziert der Algorithmus die kritischen Komponenten des Arbeitsspeichers und komprimiert den Rest in Echtzeit extrem stark.

Die harten Fakten des NVIDIA-Durchbruchs:

- 20-fache Reduktion des Speicherbedarfs für das Arbeitsgedächtnis der KI.

- Keine Änderung der Modellgewichte (die eigentliche Intelligenz bleibt unangetastet).

- Weniger als 1 % Genauigkeitsverlust bei massiver Platzersparnis.

| Methode | Vorgehensweise | Auswirkung auf HW3 |

|---|---|---|

| Quantisierung / Pruning | Permanentes "Abschneiden" von Neuronen | Geringerer Speicherbedarf, aber reduzierte Intelligenz |

| KVTC (JPEG-Stil) | Dynamische Kompression des Kontextes | Volle Intelligenz bei minimalem Speicherverbrauch |

Chance für Tesla: v14 "Full" statt "v14-lite"

Sollte Teslas KI-Team diese Methode auf das visuelle System von FSD übertragen, wäre das ein Gamechanger für Millionen von Bestandsfahrzeugen. Anstatt eine abgespeckte "Lite"-Version für HW3 zu entwickeln, könnte Tesla den vollen v14-Stack ausliefern. Die Hardware würde zwar weiterhin am Limit laufen, aber durch die hocheffiziente Verwaltung des räumlichen Gedächtnisses müsste das neuronale Netz nicht mehr künstlich verkleinert werden.

"NVIDIAs KVTC beweist, dass die KI-Industrie radikale Wege findet, Software zu optimieren, ohne immer größere Chips zu benötigen. Für HW3-Besitzer bedeutet das: Die Hardware ist alt, aber die Software muss es nicht sein."

Obwohl Tesla für den Sommer 2026 bereits eine optimierte Version für HW3 angekündigt hat, könnte dieser technologische Ansatz den Zeitplan beschleunigen oder die Qualität des Updates massiv steigern. Bis ein eventuelles HW3-Retrofit-Programm (Upgrade auf AI4/HW4) startet, bleibt die Software-Optimierung die einzige Hoffnung für das Erreichen von "Unsupervised FSD" auf älteren Fahrzeugen.